ANCOVA (analyse de covariance)

L'ANCOVA (analyse de covariance) est un modèle qui contient des variables indépendantes à la fois qualitatives et quantitatives. Faites-le dans Excel avec le logiciel XLSTAT.

Principe de l’analyse de la covariance ou ANCOVA

L'ANCOVA (Analyse de covariance) peut être vue comme un mélange d'ANOVA et de régression linéaire puisque la variable dépendante est de même nature, le modèle est aussi un modèle linéaire, et les hypothèses sont identiques. Il en réalité est plus juste de considérer l'ANOVA et la régression linéaire comme des cas particuliers de l'ANCOVA.

Modèle de l’analyse de la covariance ou ANCOVA

Si p est le nombre de variables quantitatives et q est le nombre de facteurs (les variables qualitatives, y compris les interactions entre variables qualitatives), le modèle de l'ANCOVA s'écrit de la manière suivante :

yi = β0 + ∑j=1...p βjxij + ∑j=1...q βk(i,j),j + εi

où yi est la valeur observée pour la variable dépendante pour l'observation i, xij est la valeur prise par la variable quantitative j pour l'observation i, k(i,j) est l'indice correspondant à la modalité du facteur j pour l'observation i, et εi est l'erreur du modèle.

Les hypothèses utilisées en ANCOVA sont identiques à celles de la régression linéaire et de l'ANOVA : les erreurs εi suivent une même loi normale N(0,s) et sont indépendantes.

Options pour l’analyse de la covariance ou ANCOVA dans XLSTAT

Les interactions sont calculées jusqu'à l'ordre 4 pour les facteurs, et jusqu'à l'ordre deux pour les croisements entre les facteurs et les variables quantitatives.

De plus il est possible de sélectionner les variables à prendre en compte dans l’analyse grâce à quatre options :

- Meilleur modèle : cette méthode permet de choisir le meilleur modèle parmi tous les modèles comprenant un nombre de variables variant de « Min variables » à « Max variables » à définir par l'utilisateur. Par ailleurs le « critère » pour déterminer le meilleur modèle peut être choisi par l'utilisateur. Les critères disponibles sont : R² ajusté, Moyenne des Carrés des Erreurs (MCE), Cp de Mallows, AIC de Akaike, SBC de Schwarz, PC d'Amemiya.

- Stepwise : le processus de sélection commence par l'ajout de la variable ayant la plus forte contribution au modèle (le critère utilisé est la statistique t de Student). Si une seconde variable est telle que la probabilité associée à son t est inférieure à la « Probabilité pour l'entrée », elle est ajoutée au modèle. De même pour une troisième variable. A partir de l'ajout de la troisième variable, après chaque ajout, on évalue pour toutes les variables présentes dans le modèle quel serait l'impact de son retrait (toujours au travers de la statistique t). Si la probabilité est supérieure à la « Probabilité pour le retrait », la variable est retirée. La procédure se poursuit jusqu'à ce que plus aucune variable ne puisse être ajoutée/retirée.

- Ascendante : la procédure est identique à cette de la sélection progressive, hormis le fait que les variables sont uniquement ajoutées et jamais retirées.

- Descendante : la procédure commence par l'ajout simultané de toutes les variables. Les variables sont ensuite retirées du modèle suivant la procédure utilisée pour la sélection progressive.

Dans le cas de variables ayant plusieurs niveaux, plusieurs tests et procédures de comparaisons multiples sont disponibles :

- Bonferroni,

- Dunn-Sidak,

- Dunnett,

- Fisher,

- Tukey,

- Duncan,

- REGWQ,

- Newman-Keuls.

Enfin un processus de validation est aussi disponible.

Résultats pour l’analyse de la covariance ou ANCOVA dans XLSTAT

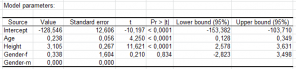

Parmis les résultats calculés par XLSTAT, le tableau d’analyse de la variance et les erreurs Type I SS, et Type III SS, permettent de déterminer les variables explicatives ayant une influence sur les résultats.

L'équation du modèle est aussi affichée pour faciliter la lecture ou la réutilisation du modèle.

Le tableau des coefficients normalisés (aussi appelés coefficients bêta) permet de comparer le poids relatif des variables. Plus la valeur absolue d'un coefficient est élevée, plus le poids de la variable correspondante est important. Lorsque l'intervalle de confiance autour des coefficients normalisés comprend la valeur 0 (cela est facilement visible sur le graphique des coefficients normalisés), le poids d'une variable dans le modèle n'est pas significatif.

Dans le tableau des prédictions et résidus sont donnés pour chaque observation, son poids, la valeur de la variable explicative qualitative s'il n'y en a qu'une, la valeur observée de la variable dépendante, la prédiction du modèle, les résidus, les intervalles de confiance, ainsi que la prédiction ajustée et le D de Cook si les options correspondantes ont été activées dans la boîte de dialogue. Deux types d'intervalles de confiance sont affichés : un intervalle de confiance autour de la moyenne (correspondant au cas où l'on ferait la prédiction pour un nombre infini d'observations avec un ensemble de valeurs données des variables explicatives) et un intervalle autour de la prédiction ponctuelle (correspondant au cas d'une prédiction isolée pour des valeurs données des variables explicatives). Le second intervalle est toujours plus grand que le premier, les aléas étant plus importants. Si des données de validation ont été sélectionnées, elles sont affichées en fin de tableau.

Les graphiques suivant permettent de visualiser les résultats mentionnés ci-dessus. S'il n'y a qu'une seule variable explicative dans le modèle, le premier graphique affiché permet de visualiser les valeurs observées, la droite de régression et les deux types d'intervalles de confiance autour des prévisions. Le second graphique permet quant à lui de visualiser les résidus normalisés en fonction de la variable explicative. En principe, les résidus doivent être distribués de manière aléatoire autour de l'axe des abscisses. L'observation d'une tendance ou d'une forme révèlerait un problème au niveau du modèle.

Les trois graphiques affichés ensuite permettent de visualiser respectivement l'évolution des résidus normalisés en fonction de la variable dépendante, la distance entre les prédictions et les observations (pour un modèle idéal, les points seraient tous sur la bissectrice), et les résidus normalisés sur la forme d'un diagramme en bâtons. Ce dernier graphique permet de rapidement voir si un nombre anormal de données sort de l'intervalle ]-2, 2[ sachant que ce dernier, sous hypothèse de normalité, doit contenir environ 95% des données.

analysez vos données avec xlstat

Fonctionnalités corollaires